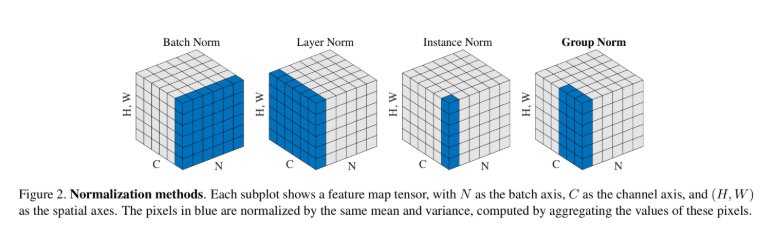

배치 정규화(표준화)와는 다른 방향으로 데이터를 표준화 작업을 거치는 방법. 한 채널 내의 데이터들을 적당한 수로 모아서(그룹별) 이를 표준화 작업을 거친다.

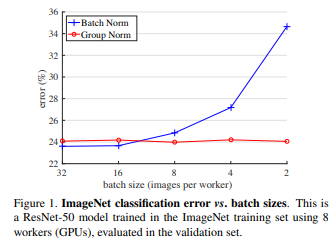

일반적으로 미니배치에서 표준화 작업을 거치는것보다는 미세하게 나은 정도지만, 강점은 배치수가 적을때에 있다. 해상도가 큰 이미지를 훈련하는 경우 시중에 나온 GPU로는 메모리가 터지는 경우가 존재한다. 또한 배치를 크게 줄수록 정확도가 미세하게 낮아지는 경우가 있어 부득이하게 배치를 10 이하로 낮추는 경우가 존재한다. 이렇게 적은 수의 배치를 돌려야 하는 경우가 많은데 이러한 경우에도 정해진 그룹안의 수에 맞춰서 표준화 작업을 하면 배치 Normalization의 이점을 누릴 수 있다.

해당 방법은 최근(2020년)에는 배치 노말라이제이션보다 정확도를 높여야 할 경우 고려되는 방법으로 모델링 시 자주 보인다.