Skip to content

- 현재 트렌드로는 다양한 합성곱 신경방등이 넓이(width), 깊이(depth), 해상도(resolution) 등의 여러가지 다양한 특성으로 합성곱 신경망 모델을 구성

- depth – resnet같은 경우를 예로 들면, 깊이에 따라 정확도가 높아짐 (일정이상은 높아지지 않고, 1000이상이면 무용지물)

- width – 여러가지 filter를 적용하여 width가 길어진 네트워크는 많은 fine-grain feature를 훈련할수 있음. 다만 너무 깊이가 얕으면 추상적레벨의 feature를 반영하지 못할 수는 있음.

- resolution – 당연히 해상도가 높아지면 정확도가 높아지지만, 600X600정도 이상이면 정확도 상승폭에 비해 하드웨어 무리

- 결국 정확도 상승을 위해 극한의 하드웨어 성능이 필요한 정도로 모델이 커지지만, 상승폭은 계속 줄어들게 됨.

- 이 셋의 밸런스를 잘 맞추는것이 제일 가성비(?)가 좋은 네트워크를 만들게 됨.

- 따라서 Efficient Net은 메모리, CPU에 따라 제일 좋은 효과를 얻을 수있는 공식을 찾아내기 시작

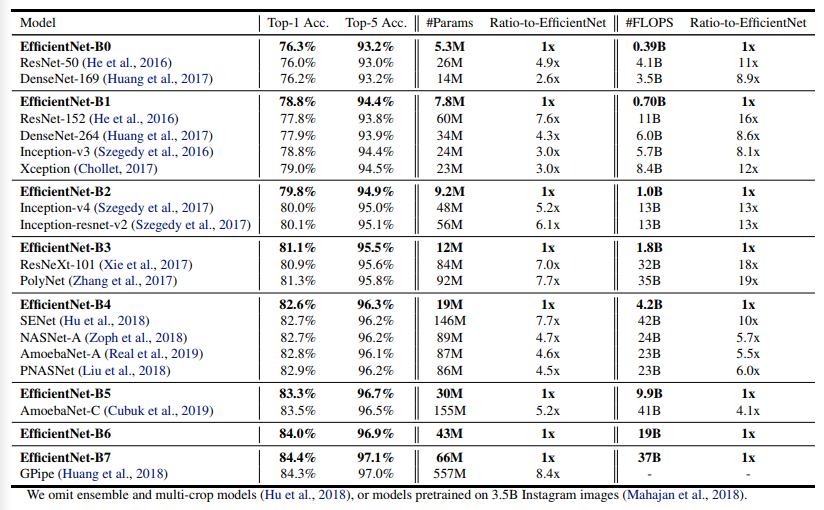

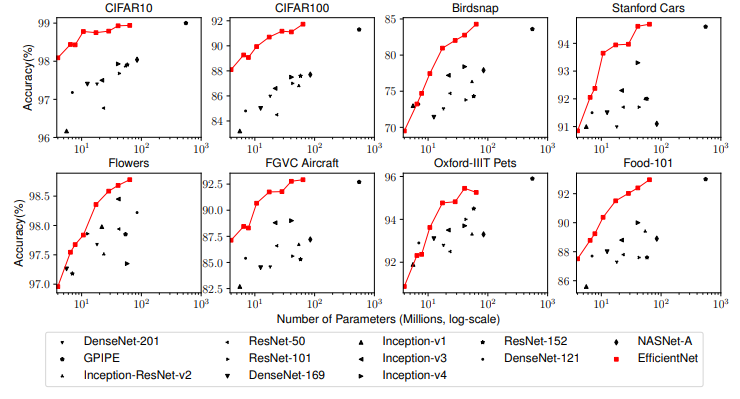

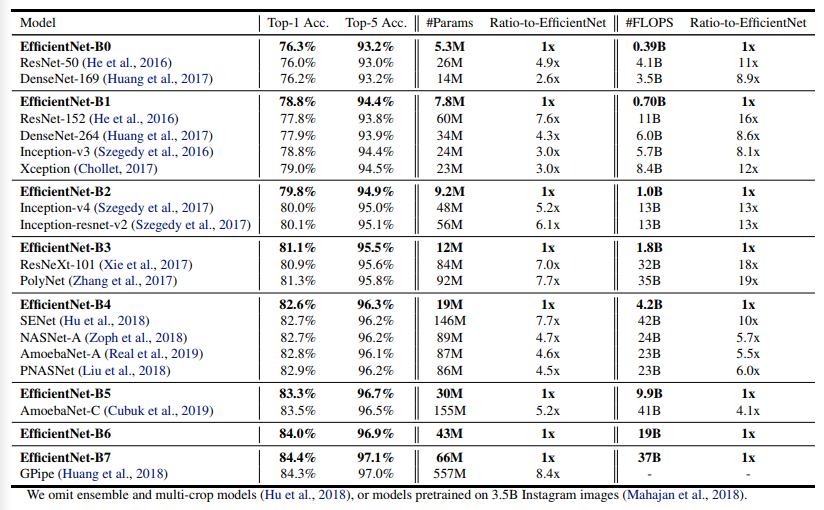

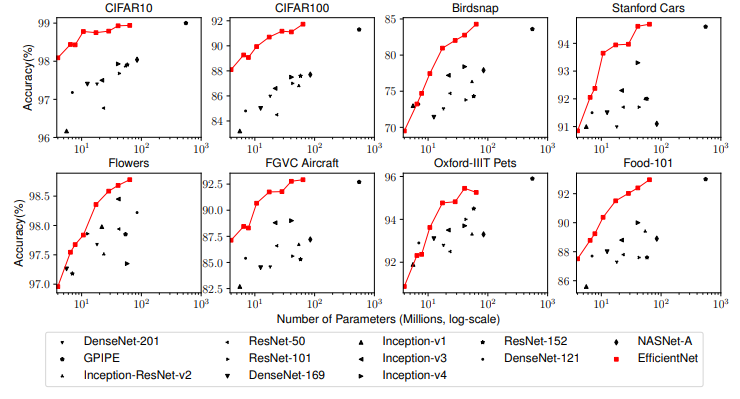

- 효과는 다음과 같이, 적은 자원으로도 State of the art 를 뛰어넘는 높은 정확도를 달성할수 있음을 보임